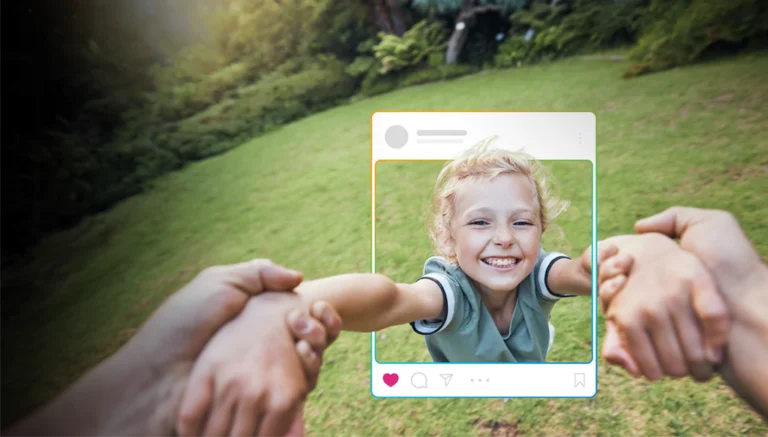

Het beschermen van klantdata bij AI-assistentimplementatie vereist een gestructureerde aanpak die privacy-by-designprincipes combineert met praktische beveiligingsmaatregelen. Succesvolle implementatie start met dataminimalisatie, GDPR-compliance en transparante leverancierselectie. Deze bescherming gaat verder dan alleen technische maatregelen en omvat ook medewerkerstraining en continue monitoring van dataverwerkingsprocessen.

Wat zijn de grootste privacyrisico’s bij AI-assistenten in klantenservice?

De grootste privacyrisico’s bij AI-assistenten zijn ongecontroleerde datalekken, ongeautoriseerde toegang tot klantgegevens en compliance-uitdagingen met GDPR-wetgeving. AI-systemen verwerken grote hoeveelheden persoonsgegevens die bij inadequate beveiliging kunnen worden misbruikt of gelekt.

Datalekken ontstaan wanneer AI-assistenten toegang hebben tot meer informatie dan noodzakelijk is voor hun functie. Veel organisaties geven AI-systemen brede toegang tot klantsystemen zonder adequate segmentatie. Dit betekent dat een AI-assistent die alleen factuurvragen moet beantwoorden, mogelijk ook toegang heeft tot medische gegevens of financiële details.

Ongeautoriseerde toegang vormt een tweede groot risico. AI-assistenten maken vaak verbinding met meerdere systemen en databases. Wanneer deze koppelingen onvoldoende beveiligd zijn, kunnen kwaadwillende partijen via de AI-assistent toegang krijgen tot klantdata. Dit risico neemt toe wanneer AI-systemen cloudgebaseerd zijn en data over verschillende locaties verspreid wordt.

GDPR-compliance-uitdagingen ontstaan omdat AI-assistenten vaak niet transparant zijn over welke data ze verzamelen en hoe ze deze verwerken. Klanten hebben recht op inzage, correctie en verwijdering van hun gegevens. Bij AI-systemen is het vaak onduidelijk waar data opgeslagen wordt en hoe deze weer verwijderd kan worden.

Welke klantdata heeft een AI-assistent eigenlijk nodig om effectief te werken?

Een AI-assistent heeft minimale, contextrelevante data nodig: basiscontactgegevens, actuele gesprekshistorie en specifieke vraagcategorieën. Dataminimalisatie is essentieel: meer data betekent niet automatisch betere prestaties, maar wel hogere privacyrisico’s.

Basiscontactgegevens omvatten naam, klantnummer en voorkeurscommunicatiekanaal. Deze informatie stelt de AI-assistent in staat om klanten te identificeren en gepersonaliseerde service te bieden. Gevoelige gegevens zoals BSN-nummers of volledige adressen zijn meestal niet noodzakelijk voor effectieve klantinteractie.

Gesprekshistorie moet beperkt blijven tot recente, relevante interacties. Een AI-assistent hoeft geen toegang te hebben tot gesprekken van jaren geleden. Drie tot zes maanden gespreksgeschiedenis is meestal voldoende om context te bieden en herhaalde vragen te voorkomen.

Gedragspatronen kunnen nuttig zijn, maar moeten geanonimiseerd worden. Informatie over veelgestelde vragen, piekuren en algemene klanttevredenheid helpt de AI-assistent beter te presteren. Deze data kan echter geaggregeerd worden zonder individuele klantprofielen bij te houden.

Productinformatie en veelgestelde vragen vormen de kennisbasis van de AI-assistent. Deze informatie bevat geen persoonsgegevens, maar stelt het systeem in staat accurate antwoorden te geven. Deze kennisbasis moet regelmatig geüpdatet worden om actuele informatie te garanderen.

Hoe zorg je ervoor dat je AI-assistent GDPR-compliant werkt?

GDPR-compliance voor AI-assistenten vereist expliciete toestemming, transparante dataverwerkingsovereenkomsten en privacy-by-designimplementatie. Audittrails en regelmatige compliance-audits zijn essentieel voor aantoonbare naleving van privacywetgeving.

Consentmanagement begint met duidelijke communicatie over wat de AI-assistent doet met klantdata. Klanten moeten actief toestemming geven voor dataverwerking door AI-systemen. Deze toestemming moet specifiek, geïnformeerd en herroepbaar zijn. Algemene privacyverklaringen zijn onvoldoende.

Data processing agreements met AI-leveranciers moeten exact specificeren welke data verwerkt wordt, waar deze opgeslagen wordt en hoe lang deze bewaard blijft. Nederlandse organisaties moeten ervoor zorgen dat data binnen de EU blijft of dat adequate beschermingsmaatregelen getroffen zijn bij dataoverdracht naar derde landen.

Privacy by design betekent dat privacybescherming vanaf het begin in het AI-systeem wordt ingebouwd. Dit omvat automatische dataminimalisatie, ingebouwde versleuteling en standaard privacyvriendelijke instellingen. Klanten moeten niet zelf privacy-instellingen hoeven aan te passen.

Audittrails registreren alle dataverwerkingsactiviteiten van de AI-assistent. Deze logs tonen wanneer welke data geraadpleegd werd, door welke functie en met welk doel. Deze informatie is essentieel voor compliancerapportage en incidentonderzoek.

Waar moet je op letten bij het kiezen van een AI-leverancier voor klantdatabeveiliging?

Bij leverancierselectie zijn ISO 27001-certificering, Nederlandse datalocatie en transparantie over algoritmes cruciaal. Evalueer ook incidentresponseprocedures, contractuele waarborgen en de mogelijkheid tot data-export bij leverancierswisseling.

Certificeringen vormen de basis voor betrouwbare dataverwerking. ISO 27001-certificering toont aan dat de leverancier systematisch werkt aan informatiebeveiliging. Aanvullende certificeringen zoals ISO 9001 en SOC 2 Type II versterken het vertrouwen in de leverancier.

Datalocatie bepaalt welke wetgeving van toepassing is. Nederlandse of EU-gebaseerde datacenters bieden de beste juridische bescherming. Leveranciers die data in de VS of andere derde landen opslaan, moeten adequate beschermingsmaatregelen aantonen conform GDPR-vereisten.

Algoritmische transparantie betekent dat de leverancier kan uitleggen hoe de AI-assistent beslissingen neemt. Blackboxalgoritmes maken het onmogelijk om bias te detecteren of verkeerde beslissingen te corrigeren. Vraag naar explainable-AI-functionaliteit.

Incidentresponseprocedures moeten duidelijk beschreven zijn. De leverancier moet binnen 24 uur dataincidenten rapporteren en concrete stappen hebben voor damagecontrol. Controleer ook of de leverancier cyberverzekering heeft en wat de dekking omvat.

Contractuele waarborgen moeten data ownership, liability en exitprocedures regelen. Zorg ervoor dat jouw organisatie eigenaar blijft van alle klantdata en dat deze volledig verwijderd wordt bij beëindiging van het contract.

Hoe train je medewerkers in veilig gebruik van AI-assistenten met klantdata?

Effectieve medewerkerstraining combineert praktische privacy-awareness met duidelijke escalatieprocedures en regelmatige updates over nieuwe risico’s. Training moet hands-on zijn en realistische scenario’s gebruiken die medewerkers dagelijks tegenkomen.

Privacy-awareness-training start met uitleg over waarom dataprivacy belangrijk is. Medewerkers moeten begrijpen welke schade datalekken kunnen veroorzaken voor klanten en de organisatie. Concrete voorbeelden van privacy-incidenten maken de risico’s tastbaar.

Praktische richtlijnen geven medewerkers concrete handvatten. Wanneer mogen ze welke data delen met de AI-assistent? Hoe herkennen ze gevoelige informatie die niet gedeeld mag worden? Welke vragen kunnen ze niet aan de AI-assistent stellen? Deze richtlijnen moeten eenvoudig en makkelijk te onthouden zijn.

Escalatieprocedures beschrijven wat medewerkers moeten doen bij verdacht AI-assistentgedrag of mogelijke privacy-incidenten. Wie moeten ze waarschuwen? Welke stappen moeten ze ondernemen? Hoe documenteren ze het incident? Snelle escalatie voorkomt dat kleine problemen grote incidenten worden.

Regelmatige updates houden medewerkers op de hoogte van nieuwe risico’s en gewijzigde procedures. Het privacylanschap en AI-technologie ontwikkelen zich snel. Kwartaalrefreshertrainingen zorgen ervoor dat kennis actueel blijft en nieuwe medewerkers snel up-to-speed zijn.

Hoe Pegamento helpt met veilige AI-assistentimplementatie

Wij bieden privacyconforme AI-implementatie met Nederlandse datalocatie, ISO 27001-gecertificeerde beveiliging en transparante compliance-ondersteuning. Onze aanpak combineert technische waarborgen met praktische implementatiebegeleiding voor zorgeloze AI-adoptie.

Onze technische waarborgen omvatten:

- Nederlandse datacenters met volledige GDPR-compliance

- ISO 27001-, ISO 9001- en ISO 26000-certificeringen voor maximale betrouwbaarheid

- Ingebouwde dataminimalisatie en privacy-by-designprincipes

- Transparante audittrails en compliancerapportage

- End-to-endversleuteling en toegangscontrole

Onze agentic AI-assistenten evolueren van traditionele uitvoerende bots naar zelfdenkende assistenten die niet alleen instructies opvolgen, maar zelfstandig initiatief nemen binnen veilige privacygrenzen. Deze intelligente assistenten respecteren dataminimalisatieprincipes terwijl ze optimale klantservice leveren.

Praktische implementatie gebeurt stapsgewijs met volledige begeleiding. We zorgen voor medewerkerstraining, compliancedocumentatie en continue monitoring. Alles onder één dak: geen complex leveranciersmanagement, maar één aanspreekpunt voor uw totale AI-oplossing op maat.

Wilt u weten hoe wij uw AI-assistent privacyconform kunnen implementeren? Neem contact op voor een vrijblijvend adviesgesprek over veilige AI-implementatie voor uw organisatie.

Veelgestelde vragen

Hoe lang mag je klantdata bewaren die door een AI-assistent is verwerkt?

De bewaartermijn hangt af van het doel waarvoor de data verzameld is en wettelijke verplichtingen. Voor klantenservice is meestal 2-3 jaar voldoende, tenzij er specifieke compliance-eisen zijn. Zorg voor automatische verwijdering na de bewaartermijn en documenteer waarom bepaalde data langer bewaard wordt.

Wat doe je als een klant vraagt om inzage in de data die de AI-assistent over hem heeft?

Onder de GDPR heeft elke klant recht op dataportabiliteit. Zorg ervoor dat je AI-systeem alle klantdata kan exporteren in een leesbaar formaat. Dit omvat gespreksgeschiedenis, gemaakte notities en eventuele geautomatiseerde beslissingen. Reageer binnen 30 dagen op zo'n verzoek.

Kunnen AI-assistenten per ongeluk gevoelige data van andere klanten delen?

Dit risico bestaat inderdaad, vooral bij onvoldoende data-isolatie. Implementeer strikte toegangscontroles zodat elke AI-sessie alleen toegang heeft tot data van de betreffende klant. Test regelmatig of de isolatie werkt en monitor alle AI-outputs op onbedoelde datalekken.

Hoe zorg je ervoor dat een AI-assistent stopt met leren van gevoelige klantgesprekken?

Configureer je AI-systeem zo dat het niet automatisch leert van productiedata. Gebruik een aparte, geanonimiseerde dataset voor training en updates. Implementeer ook 'vergeetfunctionaliteit' waarbij de AI-assistent gevoelige informatie niet onthoudt na afloop van een gesprek.

Wat zijn de kosten van een privacy-incident met een AI-assistent?

Privacy-incidenten kunnen leiden tot GDPR-boetes tot €20 miljoen of 4% van de jaaromzet. Daarnaast zijn er kosten voor incidentrespons, juridische bijstand, reputatieschade en mogelijke schadeclaims. Investeren in goede privacy-waarborgen vooraf is altijd goedkoper dan achteraf opruimen.

Hoe test je of je AI-assistent privacy-vriendelijk genoeg werkt voordat je live gaat?

Voer een privacy impact assessment (PIA) uit en test met synthetische data die echte klantscenario's nabootst. Controleer of dataminimalisatie werkt, test de 'recht op vergeten'-functionaliteit en laat een externe partij een penetratietest uitvoeren. Documenteer alle testresultaten voor compliance-doeleinden.