Het testen van een AI-assistent voordat deze live gaat, is essentieel om betrouwbare prestaties te garanderen. Grondige tests voorkomen reputatieschade, operationele problemen en teleurgestelde gebruikers. Een systematische testbenadering omvat functionele tests, conversatie-evaluatie, prestatiemetingen en realistische scenario’s. Goede voorbereiding zorgt ervoor dat je AI-assistent vanaf dag één waarde toevoegt aan je organisatie.

Waarom is het testen van een AI-assistent zo cruciaal voordat deze live gaat?

Ongeteste AI-systemen kunnen aanzienlijke schade aanrichten aan je klantrelaties en bedrijfsoperaties. Een AI-assistent die onjuiste informatie verstrekt, gesprekken verkeerd interpreteert of technisch faalt tijdens piekuren, creëert direct negatieve ervaringen die moeilijk te herstellen zijn.

De impact van een slecht functionerende AI-assistent strekt zich uit over meerdere gebieden. Klanten verliezen vertrouwen wanneer ze inconsistente of onjuiste antwoorden ontvangen. Medewerkers raken gefrustreerd omdat ze constant moeten ingrijpen om fouten te corrigeren. Het management ziet geen return on investment omdat de AI-assistent meer problemen creëert dan oplost.

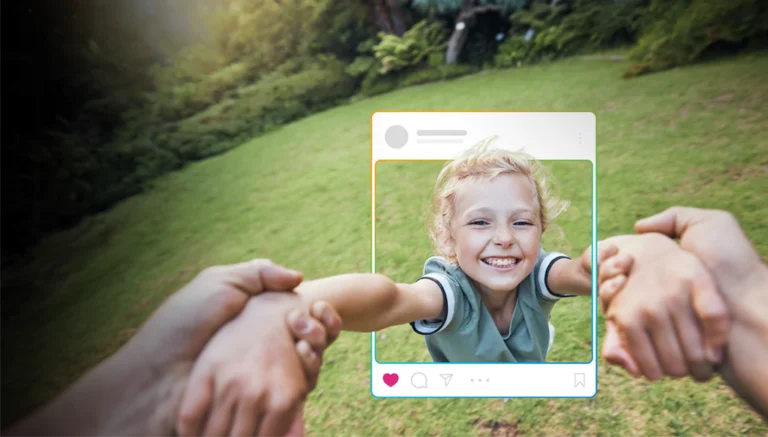

Reputatieschade ontstaat snel wanneer klanten negatieve ervaringen delen via sociale media of recensieplatforms. Een AI-assistent die gevoelige onderwerpen verkeerd behandelt of ongepaste reacties geeft, kan binnen enkele uren tot virale negativiteit leiden.

Operationele problemen manifesteren zich als verhoogde werkdruk voor je klantenserviceteam, langere wachttijden voor klanten en hogere kosten door inefficiënte processen. Grondige tests voorkomen deze problemen door zwakke punten te identificeren voordat echte klanten ermee in contact komen.

Welke verschillende testmethoden kun je gebruiken voor AI-assistenten?

Er bestaan vijf hoofdcategorieën van testmethoden voor AI-assistenten: functionele tests, conversatietests, stresstests, integratietests en gebruikerstests. Elke methode richt zich op specifieke aspecten van de AI-prestaties en moet onderdeel uitmaken van een complete teststrategie.

Functionele tests controleren of de AI-assistent basisfuncties correct uitvoert. Dit omvat het testen van antwoordnauwkeurigheid, informatieophaling uit databases en het correct doorverwijzen van complexe vragen naar menselijke medewerkers. Deze tests vormen de basis voor alle andere testactiviteiten.

Conversatietests evalueren hoe natuurlijk en logisch de AI-assistent communiceert. Hierbij test je meertraps gesprekken, contextbehoud tussen verschillende onderwerpen en de capaciteit om onduidelijke vragen te verduidelijken. Deze methode onthult problemen in de gespreksflow die functionele tests missen.

Stresstests simuleren extreme omstandigheden zoals hoge gebruikersvolumes, complexe vragen en technische storingen. Dit toont aan hoe de AI-assistent presteert onder druk en helpt capaciteitsgrenzen te bepalen voordat je live gaat.

Integratietests controleren hoe de AI-assistent samenwerkt met bestaande systemen zoals CRM-platforms, ticketingtools en kennisdatabases. Deze tests voorkomen problemen met data-uitwisseling en systeemcompatibiliteit.

Gebruikerstests laten echte medewerkers en een beperkte groep klanten interacteren met de AI-assistent in een gecontroleerde omgeving. Deze methode onthult praktische gebruiksproblemen die technische tests niet detecteren.

Hoe test je de nauwkeurigheid en betrouwbaarheid van AI-antwoorden?

Het valideren van AI-antwoorden vereist systematische controle van antwoordkwaliteit, consistentie en feitelijke juistheid. Begin met het opstellen van een referentieset van correcte antwoorden op veelgestelde vragen. Test vervolgens verschillende manieren om dezelfde vraag te stellen en controleer of de AI-assistent consistente, juiste antwoorden geeft.

Edgecase-tests zijn cruciaal voor betrouwbaarheid. Test extreme scenario’s zoals zeer lange vragen, vragen met spelfouten, dubbelzinnige formuleringen en vragen die meerdere onderwerpen combineren. Deze situaties onthullen zwakke punten in de AI-logica die bij normale tests verborgen blijven.

Consistentie-evaluatie controleert of de AI-assistent dezelfde vraag altijd op dezelfde manier beantwoordt. Variatie in antwoorden op identieke vragen wijst op instabiliteit in het AI-systeem die gebruikers zal verwarren.

Biasdetectie identificeert ongewenste vooroordelen in AI-antwoorden. Test vragen over gevoelige onderwerpen en controleer of antwoorden neutraal en inclusief zijn. Documenteer gevallen waarin de AI ongepaste aannames maakt over gebruikers.

Antwoordkwaliteit meet je aan de hand van criteria zoals volledigheid, relevantie en bruikbaarheid. Een correct maar onvolledig antwoord kan voor de gebruikerservaring even problematisch zijn als een volledig verkeerd antwoord.

Wat zijn de belangrijkste prestatie-indicatoren bij het testen van AI-assistenten?

Vijf kernmetrieken bepalen de effectiviteit van je AI-assistent: responstijd, nauwkeurigheidspercentage, escalatieratio, gebruikerstevredenheid en conversatievoltooiingspercentage. Deze KPI’s geven een compleet beeld van zowel technische prestaties als gebruikerservaring.

Responstijd meet hoe snel de AI-assistent antwoordt op gebruikersvragen. Streef naar antwoordtijden onder de drie seconden voor eenvoudige vragen en onder de tien seconden voor complexere zoekopdrachten. Langere responstijden leiden tot gebruikersfrustratie en verhoogde uitval.

Het nauwkeurigheidspercentage toont het aandeel correcte antwoorden ten opzichte van het totaal aantal vragen. Een nauwkeurigheid van minimaal 85% is acceptabel voor de meeste toepassingen, maar streef naar 95% of hoger voor kritieke informatie zoals technische specificaties of beleidsdetails.

De escalatieratio geeft aan hoe vaak de AI-assistent gesprekken doorverwijst naar menselijke medewerkers. Een ratio tussen 15 en 25% is normaal, afhankelijk van de complexiteit van je dienstverlening. Een te hoge escalatie duidt op tekortschietende AI-capaciteiten, een te lage escalatie kan wijzen op geforceerde antwoorden.

Gebruikerstevredenheid meet je via directe feedback na gesprekken of periodieke enquêtes. Scores boven de 4 op een 5-puntsschaal wijzen op een succesvolle implementatie. Let vooral op kwalitatieve feedback die specifieke verbeterpunten identificeert.

Het conversatievoltooiingspercentage toont hoeveel gesprekken succesvol worden afgerond zonder dat gebruikers vroegtijdig stoppen. Percentages boven 80% duiden op effectieve AI-interacties die gebruikersbehoeften vervullen.

Hoe simuleer je realistische gebruikersscenario’s tijdens AI-tests?

Realistische tests vereisen diverse testdata die echte gebruikersinteracties nabootst. Verzamel voorbeelden van daadwerkelijke klantvragen uit je huidige kanalen en gebruik deze als basis voor testscenario’s. Varieer in vraagcomplexiteit, emotionele toon en technische specificiteit om alle aspecten van je klantenservice te dekken.

Verschillende gebruikerstypes hebben unieke communicatiepatronen die je moet simuleren. Test scenario’s voor technisch onderlegde gebruikers die specifieke details verwachten, maar ook voor gebruikers die basisuitleg nodig hebben. Simuleer gesprekken met gehaaste gebruikers die korte antwoorden willen en gebruikers die uitgebreide begeleiding verwachten.

Complexe conversaties testen meerdere onderwerpen binnen één gesprek. Simuleer situaties waarin gebruikers van onderwerp wisselen, eerdere vragen herformuleren of aanvullende informatie vragen over vorige antwoorden. Deze scenario’s testen het contextuele begrip van je AI-assistent.

Onverwachte input omvat typfouten, autocorrectiefouten, incomplete zinnen en vragen in andere talen. Test ook scenario’s met emotioneel geladen taal, sarcastische opmerkingen en vragen die buiten je bedrijfsdomein vallen.

Piekbelastingsimulaties testen hoe de AI-assistent presteert tijdens drukke perioden. Simuleer situaties met meerdere gelijktijdige gesprekken en controleer of de prestaties stabiel blijven. Test ook herstel na technische onderbrekingen om de bedrijfscontinuïteit te waarborgen.

Hoe Pegamento helpt met AI-assistentimplementatie en -tests

Wij bieden een complete aanpak voor AI-assistentimplementatie, waarbij tests centraal staan in ons ontwikkelproces. Onze ervaring met geïntegreerde digitale oplossingen stelt ons in staat om AI-assistenten te ontwikkelen die naadloos integreren met je bestaande klantcontactinfrastructuur.

Onze testprotocollen omvatten:

- Gefaseerde implementatie – Geleidelijke uitrol met uitgebreide tests per fase

- Realtime monitoring – Continue prestatiebewaking en automatische waarschuwingen

- Agentic AI-technologie – Evolutie van uitvoerende bots naar zelfdenkende assistenten die zelfstandig initiatief nemen

- Integratietests – Volledige compatibiliteitscontrole met bestaande systemen

- Gebruikersacceptatietests – Uitgebreide validatie met je eigen medewerkers en klanten

Door onze ISO 27001-certificering garanderen we veilige testprocedures die je bedrijfsgegevens beschermen. Onze "alles onder één dak"-benadering betekent dat je één aanspreekpunt hebt voor ontwikkeling, tests, implementatie en ondersteuning – geen complex leveranciersmanagement met meerdere partijen.

Ontdek hoe wij je kunnen helpen met een betrouwbare AI-assistentimplementatie. Neem contact op voor een vrijblijvend gesprek over je specifieke test- en implementatiebehoeften.

Veelgestelde vragen

Hoe lang duurt het testproces van een AI-assistent gemiddeld voordat deze productierijp is?

Het testproces duurt typisch 4-8 weken, afhankelijk van de complexiteit van je AI-assistent en het aantal integraties. Dit omvat 1-2 weken functionele tests, 2-3 weken scenario-evaluatie, 1 week stresstests en 1-2 weken gebruikersacceptatietests. Complexere implementaties met veel externe integraties kunnen 10-12 weken vereisen.

Wat moet ik doen als mijn AI-assistent tijdens tests een nauwkeurigheidspercentage van slechts 70% behaalt?

Een nauwkeurigheid van 70% is te laag voor productiegebruik. Analyseer eerst welke vraagtypen het meest foutief worden beantwoord en verbeter de trainingsdata voor deze categorieën. Overweeg ook om de scope te beperken tot onderwerpen waarbij de AI wel goed presteert, en geleidelijk uit te breiden naarmate de prestaties verbeteren.

Kan ik de AI-assistent alvast live zetten voor een beperkte groep gebruikers tijdens het testproces?

Ja, een gefaseerde uitrol met een pilotgroep van 10-50 gebruikers is een uitstekende teststrategie. Zorg ervoor dat deze gebruikers weten dat ze deelnemen aan een test en stel duidelijke feedback-mechanismen in. Monitor de prestaties extra intensief en heb altijd een direct escalatiepad naar menselijke medewerkers beschikbaar.

Welke tools of platforms zijn het meest geschikt voor het automatiseren van AI-assistentests?

Voor geautomatiseerde tests zijn platforms zoals Botium, Chatbot Testing Framework en custom Python-scripts met libraries zoals Selenium populaire keuzes. Deze tools kunnen duizenden testscenario's parallel uitvoeren en prestatiemetrieken automatisch rapporteren. Kies tools die integreren met je bestaande CI/CD-pipeline voor optimale efficiency.

Hoe vaak moet ik mijn AI-assistent opnieuw testen nadat deze live is gegaan?

Voer maandelijks beperkte regressietests uit om prestatievermindering te detecteren. Uitgebreide tests zijn nodig bij elke grote update, nieuwe integratie of significante wijziging in je bedrijfsprocessen. Daarnaast is continue monitoring van KPI's essentieel - stel automatische waarschuwingen in wanneer nauwkeurigheid onder 90% daalt of responstijden stijgen.

Wat zijn veelgemaakte fouten bij het testen van AI-assistenten die ik moet vermijden?

Vermijd het testen met alleen 'perfecte' vragen - echte gebruikers maken typfouten en stellen onduidelijke vragen. Test niet alleen technische functionaliteit, maar ook de gebruikerservaring en emotionele intelligentie. Een andere veelgemaakte fout is het negeren van edge cases en het niet testen van de AI's reactie op vragen buiten het kennisdomein.