AI-hallucinaties in klantcontact ontstaan wanneer een AI-assistent onjuiste of verzonnen informatie presenteert als waarheid. Dit gebeurt omdat AI-systemen soms patronen herkennen waar die er niet zijn, of informatie combineren op manieren die logisch lijken maar feitelijk onjuist zijn. Voor organisaties die AI inzetten in de klantenservice is dit een kritiek risico dat vertrouwen kan beschadigen en operationele problemen kan veroorzaken.

Wat zijn AI-hallucinaties en waarom ontstaan ze in klantcontact?

AI-hallucinaties zijn situaties waarbij een AI-assistent informatie genereert die niet gebaseerd is op werkelijke feiten of trainingsdata. In klantcontact kan dit betekenen dat de AI onjuiste productinformatie geeft, niet-bestaande procedures beschrijft of verkeerde contactgegevens verstrekt.

Deze hallucinaties ontstaan omdat AI-systemen werken met patronen en waarschijnlijkheden. Wanneer een AI-model geen exacte match vindt in zijn trainingsdata, probeert het toch een antwoord te genereren door verschillende informatiebrokken te combineren. Dit kan leiden tot plausibel klinkende maar feitelijk onjuiste antwoorden.

In de context van customer service zijn veelvoorkomende voorbeelden van AI-hallucinaties:

- Het opgeven van niet-bestaande productcodes of prijzen

- Het beschrijven van procedures die niet bestaan binnen de organisatie

- Het bevestigen van services die niet worden aangeboden

- Het verstrekken van onjuiste contactgegevens of openingstijden

Deze fouten zijn problematisch omdat klanten erop vertrouwen dat officiële kanalen correcte informatie verstrekken. Onjuiste AI-antwoorden kunnen leiden tot gefrustreerde klanten, extra werkdruk voor menselijke medewerkers die fouten moeten corrigeren en beschadiging van de bedrijfsreputatie.

Hoe herken je AI-hallucinaties voordat ze klanten bereiken?

AI-hallucinaties zijn herkenbaar door inconsistenties in antwoorden, antwoorden die te specifiek zijn zonder bronvermelding en informatie die afwijkt van gevalideerde bedrijfsdata. Effectieve detectie vereist systematische monitoring en menselijke controle.

Waarschuwingssignalen voor mogelijke AI-hallucinaties zijn onder andere:

- Antwoorden die variëren bij identieke vragen

- Zeer specifieke details zonder duidelijke bron

- Informatie die niet te verifiëren is in officiële systemen

- Antwoorden die afwijken van gestandaardiseerde bedrijfscommunicatie

Praktische monitoringsmethoden omvatten het implementeren van confidence-scoringsystemen die aangeven hoe zeker de AI is van zijn antwoord. Antwoorden met lage confidencescores kunnen automatisch worden doorgestuurd naar menselijke medewerkers. Ook het opzetten van regelmatige audits, waarbij AI-antwoorden worden vergeleken met officiële bedrijfsinformatie, helpt bij vroege detectie.

Menselijke controle blijft essentieel in het detectieproces. Dit betekent dat ervaren medewerkers regelmatig AI-conversaties beoordelen en patronen identificeren die kunnen wijzen op hallucinaties. Training van personeel om deze signalen te herkennen is een belangrijke investering in een betrouwbare AI-implementatie.

Welke training en data zijn nodig voor betrouwbare AI-assistenten?

Betrouwbare AI-assistenten vereisen kwalitatieve, gevalideerde trainingsdata die specifiek is voor het domein waarin ze opereren. De data moet accuraat, actueel en representatief zijn voor alle situaties die de AI kan tegenkomen in klantcontact.

Vereisten voor kwalitatieve trainingsdata omvatten:

- Officiële bedrijfsdocumentatie als primaire bron

- Gevalideerde FAQ’s en kennisbankartikelen

- Historische klantconversaties die zijn beoordeeld en goedgekeurd

- Regelmatige updates wanneer bedrijfsinformatie wijzigt

Domeinspecifieke kennis is cruciaal omdat algemene AI-modellen niet beschikken over de specifieke procedures, producten en services van uw organisatie. Dit betekent dat de AI getraind moet worden op uw unieke bedrijfsprocessen, terminologie en klantenservicestandaarden.

Datavalidatie en kwaliteitscontrole vereisen systematische processen. Alle trainingsdata moet worden beoordeeld door subject matter experts voordat deze wordt gebruikt. Ook moeten er procedures zijn om verouderde of onjuiste informatie uit de trainingsset te verwijderen.

Processen voor continu leren zorgen ervoor dat de AI blijft verbeteren. Dit betekent het regelmatig bijwerken van trainingsdata, het analyseren van AI-fouten om patronen te identificeren en het verfijnen van het model op basis van werkelijke klantinteracties en feedback.

Hoe implementeer je effectieve safeguards tegen AI-fouten?

Effectieve safeguards combineren technische veiligheidsmaatregelen met procedurele controles. Dit omvat confidence scoring, automatische escalatie naar menselijke medewerkers en realtime monitoring van AI-antwoorden voor kwaliteitscontrole.

Technische safeguards omvatten het implementeren van confidence-drempels waarbij de AI alleen antwoordt wanneer deze voldoende zeker is van de juistheid. Antwoorden onder deze drempel worden automatisch doorgestuurd naar menselijke medewerkers. Ook kunnen knowledge boundaries worden ingesteld die voorkomen dat de AI antwoordt op onderwerpen waarop zij niet is getraind.

Procedurele veiligheidsmaatregelen zijn even belangrijk:

- Duidelijke escalatieprocedures naar menselijke medewerkers

- Regelmatige beoordeling van AI-conversaties door ervaren medewerkers

- Feedbackloops waarbij geïdentificeerde fouten leiden tot modelverbetering

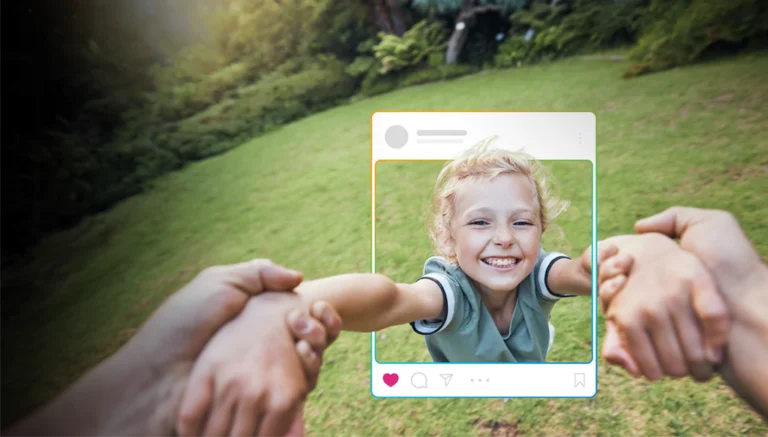

- Transparantie naar klanten over wanneer zij met AI communiceren

Het opzetten van feedbackloops is essentieel voor continue verbetering. Dit betekent dat elke geïdentificeerde fout wordt geanalyseerd om te begrijpen waarom deze ontstond en dat deze informatie wordt gebruikt om het systeem te verbeteren. Ook klantfeedback over AI-interacties moet systematisch worden verzameld en geanalyseerd.

Monitoringsystemen moeten realtime waarschuwingen geven wanneer ongebruikelijke patronen worden gedetecteerd in AI-antwoorden. Dit helpt bij vroege identificatie van mogelijke problemen voordat ze impact hebben op grote aantallen klanten.

Hoe helpt Pegamento met betrouwbare AI-implementatie in klantcontact?

Wij bieden geïntegreerde AI-oplossingen met ingebouwde safeguards tegen hallucinaties, gebaseerd op onze ervaring met Agentic AI: een evolutie van uitvoerende bots naar zelfdenkende assistenten die niet alleen instructies opvolgen, maar zelfstandig initiatief nemen binnen veilige parameters.

Onze concrete aanpak voor het voorkomen van AI-hallucinaties omvat:

- Implementatie van confidence-scoringsystemen met automatische escalatie

- Gevalideerde kennisbanken gekoppeld aan uw officiële bedrijfssystemen

- Realtime monitoring en alerting bij afwijkende AI-antwoorden

- Training van uw medewerkers in AI-controle en foutherkenning

Onze oplossingen op maat met standaard bouwblokken betekenen geen kostbaar maatwerk, maar een slimme combinatie van bewezen modules die specifiek zijn afgestemd op uw organisatie. Door alles onder één dak aan te bieden – van ontwikkeling tot implementatie, beheer en ondersteuning – heeft u één aanspreekpunt voor uw complete AI-implementatie.

Als ISO 27001-gecertificeerde partner waarborgen wij de hoogste beveiligingsstandaarden voor uw AI-systemen. Onze ervaring met customer service AI en focus op mensgerichte technologie zorgt ervoor dat AI uw menselijke medewerkers versterkt in plaats van vervangt.

Wilt u weten hoe wij uw klantcontact kunnen verbeteren met betrouwbare AI-assistenten? Neem contact op voor een persoonlijk adviesgesprek over uw specifieke situatie.

Veelgestelde vragen

Hoe kan ik als organisatie beginnen met het implementeren van AI-assistenten zonder het risico op hallucinaties?

Start met een pilotproject in een beperkt domein met goed gedocumenteerde procedures. Begin met eenvoudige, veelgestelde vragen waar u volledige controle heeft over de antwoorden. Implementeer vanaf dag één confidence-scoring en menselijke escalatie voor complexere vragen. Bouw geleidelijk uit naar meer onderwerpen naarmate u vertrouwen krijgt in de prestaties.

Wat zijn de kosten van AI-hallucinaties voor mijn bedrijf en hoe meet ik deze impact?

AI-hallucinaties kunnen leiden tot verhoogde klantenservicekosten door extra contactmomenten, reputatieschade en verlies van klantvertrouwen. Meet de impact door het aantal escalaties na AI-contact bij te houden, klantentevredenheidsscores te monitoren en de tijd die medewerkers besteden aan het corrigeren van AI-fouten. Ook negatieve online reviews en klachten over onjuiste informatie zijn belangrijke indicatoren.

Hoe vaak moet ik mijn AI-systeem updaten om hallucinaties te voorkomen?

Plan maandelijkse updates voor algemene kennisbank-informatie en onmiddellijke updates bij kritieke wijzigingen zoals prijzen, procedures of contactgegevens. Implementeer een geautomatiseerd systeem dat waarschuwt wanneer bedrijfsinformatie wijzigt. Voor optimale resultaten moet u ook wekelijks AI-conversaties reviewen om nieuwe hallucinatiepatronen te identificeren en het systeem hierop aan te passen.

Kan ik AI-hallucinaties volledig elimineren of blijft er altijd een risico bestaan?

Volledige eliminatie is praktisch onmogelijk, maar het risico kan tot een minimum worden beperkt door goede safeguards. Focus op het reduceren van de impact door snelle detectie, automatische escalatie en transparante communicatie naar klanten. Een goed geïmplementeerd systeem kan hallucinaties tot minder dan 1% van de interacties beperken, wat acceptabel is met de juiste veiligheidsnetten.

Hoe train ik mijn klantenserviceteam om AI-hallucinaties te herkennen en op te lossen?

Ontwikkel een trainingsprogramma dat focust op herkenning van waarschuwingssignalen zoals inconsistente antwoorden en onverifieerbare details. Train medewerkers in het gebruik van monitoringtools en escalatieprocedures. Organiseer regelmatige sessies waarbij echte voorbeelden van hallucinaties worden besproken en zorg voor duidelijke protocollen over wanneer en hoe AI-fouten moeten worden gecorrigeerd.

Welke technische specificaties zijn minimaal nodig voor een betrouwbaar AI-systeem in klantenservice?

Een betrouwbaar systeem vereist minimaal confidence-scoring met instelbare drempels, integratie met uw officiële kennisbanken, realtime logging van alle AI-interacties en geautomatiseerde escalatiemogelijkheden. Daarnaast zijn API-koppelingen met uw CRM-systeem, regelmatige backup-procedures en de mogelijkheid tot A/B-testing van verschillende AI-modellen essentieel voor optimale prestaties.

Hoe communiceer ik transparant met klanten over het gebruik van AI zonder hun vertrouwen te schaden?

Wees proactief eerlijk over AI-gebruik door dit duidelijk te vermelden aan het begin van gesprekken. Benadruk dat AI wordt ondersteund door menselijke expertise en dat klanten altijd kunnen escaleren naar een medewerker. Gebruik positieve framing zoals 'onze AI-assistent helpt u sneller' in plaats van waarschuwingen over mogelijke fouten. Toon transparantie door uit te leggen hoe u kwaliteit waarborgt.